作者 | 黎 澜

编辑 | 章涟漪

“特斯拉Autopilot存在关键安全缺口”。“在所有特斯拉硬件版本和事故情况下,都发现了驾驶员未采取或较晚采取规避行动的情况下发生的事故。”……在对特斯拉进行了长达三年的调查后,NHTSA(美国国家公路交通安全管理局)给出了上述结论。NHTSA认为,特斯拉的驾驶员参与系统非常薄弱,不足以支持Autopilot宽松的操作能力,可能增加驾驶安全风险。

特斯拉Autopilot是L2级别自动驾驶,在车辆智驾时需要驾驶员“始终监控交通环境”,并随时准备接管控制权。由于产品的名字里有自动(Auto)一词,使得不少特斯拉驾驶员认为这车能“自动”开。2021年8月13日,NHTSA以10多起Autopilot导致的事故为由,对特斯拉进行工程安全分析。如今,三年即将过去,今年4月末,NHTSA终于宣布这起调查结案。调查结果显示,在涉及的956起事故中,“关键安全缺口”造成了467起事故。其中,在211起事故中,特斯拉车辆在有足够反应时间的情况下,正面撞上其他车辆或障碍物;另外还有256起事故与驾驶员误操作Autosteer(自动转向)系统,或该系统在雨天等低摩擦力环境下被错误激活有关。

NHTS认为,“关键安全缺口”造成467起事故与车企强调“没有辅助驾驶马路上也会有大量致死事故”不同,NHTSA的视角则是这些系统的设计,是否会造成驾驶员“过分自信”,从而导致一系列本可以避免的事故。在NHTSA看来,目前自动驾驶系统的发展水平,并不值得人类完全的信任,而特斯拉的设计可能导致“可预见的错误使用和可避免的碰撞”。这一调查结果对于特斯拉来说,肯定不是一个好消息。但更坏的是,此番调查结束的出炉不是终点,而是新一轮调查的开始。

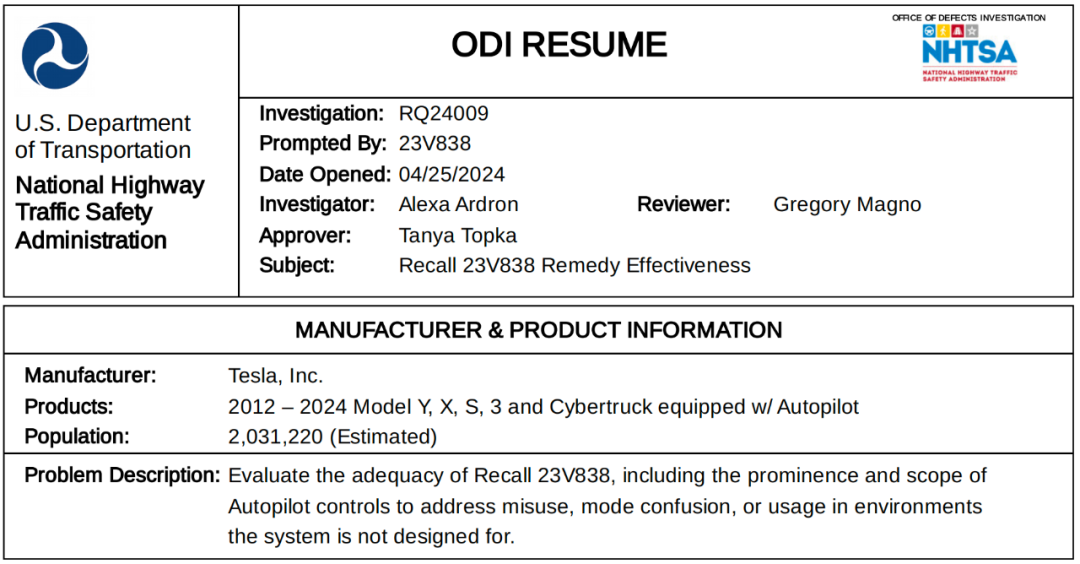

NHTSA透露,它正在启动一项新调查,以评估特斯拉去年12月对超过200万辆汽车实施的召回修复,是否确实足以解决围绕其Autopilot驾驶员辅助系统的安全问题。此外,NHTSA表示,由于特斯拉的消费者在使用其自动驾驶系统时仍不断发生撞车事故,要求特斯拉在今年7月1日的最后期限前,向其提供有关该公司有史以来最大规模召回的信息。双方的“拉锯战”远没有结束。01特斯拉Autopilot究竟有没有问题?在NHTSA看来,特斯拉Autopilot是有问题的。据NHTSA针对“特斯拉Autopilot”的EA22002号工程分析文件显示,该系统存在“关键安全缺口”,导致至少467起撞车,其中有13起致死事故,还有许多导致严重受伤的案例。

调查覆盖了2018年到2022年8月的446起事故,包括对目标车辆车载摄像头视频、事件数据的深入评估记录器 (EDR)、数据日志和其他信息的分析。另外,NHTSA还通过分析了缺陷调查办公室(ODI)收集到的2022年8月至2023年8月发生的510起特斯拉事故,为其评估增加置信度。

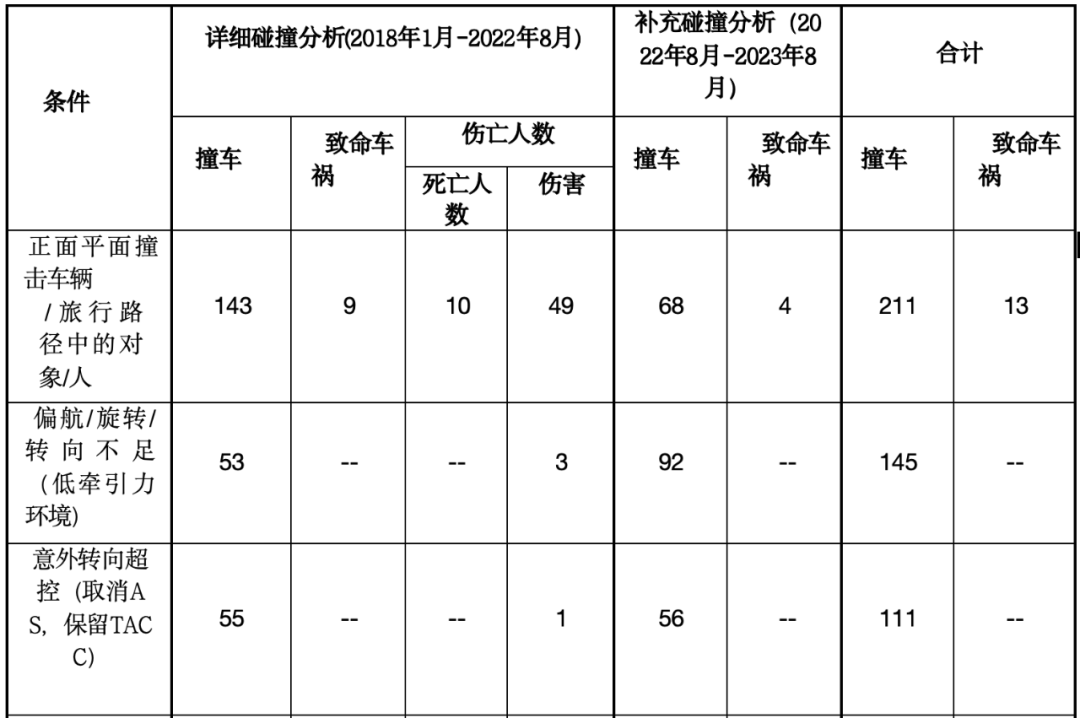

两者得出的结论是一致的。根据NHTSA介绍,截至 2023 年 8 月 30 日,其调查审查的 956 起报告撞车事故中,大约一半(489 起)要么“没有足够的数据进行评估”,要么是车有故障,自动驾驶仪被发现未使用或崩溃与探测器无关。其余467起事故分为三类:211起事故中,“特斯拉的正面撞到了另一辆车或障碍物,有足够的时间让细心的驾驶员做出反应以避免或减轻事故。145起事故涉及“在湿滑路面等低牵引力条件下偏离道路”。

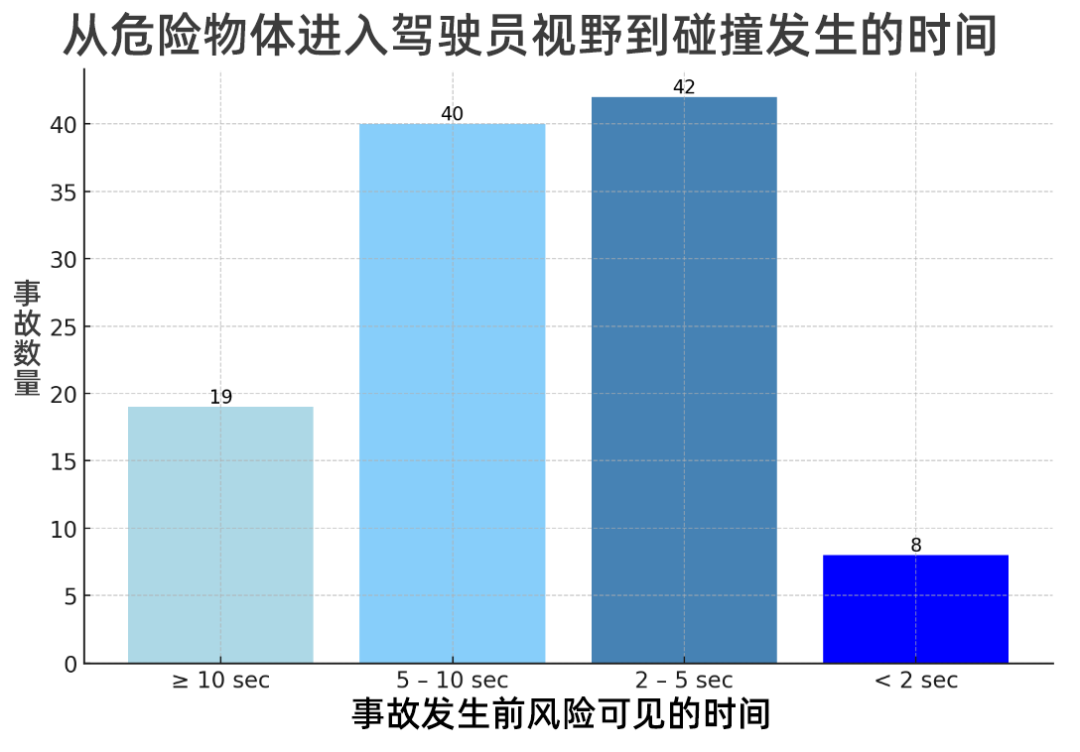

111起事故涉及“车道偏离,自动驾驶系统因驾驶员的操作而无意中脱离”。基于上述数据,NHTSA认为,在“召回23V838”之前,Autopilot的设计不足以保持驾驶员的参与度。“召回23V838”是特斯拉于2023年12月12日提交了一份缺陷信息报告。报告中特斯拉称,在某些情况下,Autopilot的系统控制可能不足以满足需要对人类驾驶员的持续监督。NHTSA进一步分析2018年到2022年8月的446起事故发现,在143起撞车事故里,有109起事故的数据足以测量撞击和危险进入驾驶员视野之间的时间。

109起事故发生前风险可见时间这些碰撞中,超过一半(59起)的碰撞中,危险在撞击前5秒或更长时间即可见,其中19起在碰撞前10秒以上可见危险。在NHTSA看来,对于那些危险可见时间较短的事件,例如在撞车前不到两秒钟首次发现危险的事件,即使驾驶员可能无法完全避免撞车,细心的驾驶员及时的行动也可以减轻撞车的严重性。

具体案例分析显示,许多车祸发生在驾驶员能够看到前方危险的情况下。例如,2023年7月在弗吉尼亚州沃伦顿发生的致命车祸中,一辆2023年款的Model Y在高速公路上与一个正在转弯的拖车相撞。调查表明,如果驾驶员保持警觉,应该能够看到牵引车,并有足够的时间可以避免这次碰撞。

因此,NHTSA认为,特斯拉的Autopilot系统在设计上存在不足,未能有效保持驾驶员的参与。尽管特斯拉要求驾驶员在使用Autopilot时必须时刻监控,但实际上,系统的警告并不足以确保驾驶员持续关注驾驶任务。此外,与其他L2级别的自动辅助系统相比,特斯拉的系统在驾驶员干预和系统控制权方面存在明显差异。Autopilot在驾驶员尝试手动干预时表现出抵抗。其他系统倾向于在驾驶员进行手动操作时暂停车道保持辅助功能,然后在无需额外操作的情况下重新激活。

另外,NHTSA对特斯拉的“Auto”措辞较为反对。相比之下,其他L2级别的系统通常使用如“assist”(辅助)、“sense”(感知)或“team”(团队)等更为保守的命名,这些术语强调驾驶员和自动化系统应共同工作,由驾驶员监督自动化系统。在NHTSA看来,特斯拉保持司机参与度的手段不足,其系统过于宽松,导致驾驶员的期望与Autopilot的实际功能之间存在“严重的安全缺口”。NHTSA还认为,由于特斯拉遥测数据中的“空白”,其调查可能不完整。

这可能意味着涉及 Autopilot 和 FSD 的事故比发现的要多得多。02调查从2021年开始,双方不断拉扯根据美国汽车召回相关法规和监管程序,大部分缺陷调查都是从初步评估(PE)开始的。通常这个阶段持续约4个月。在此期间,NHTSA会要求制造商提供相关信息,并通过信息分析和评估来确定车辆是否存在安全缺陷以及是否需要召回。如果在PE阶段无法得出结论,将进入工程分析(EA)阶段。EA阶段,通常需要进行更详细的技术分析和调查,甚至进行测试和试验。这个过程通常会在12个月内完成。不过,在特殊情况下,这个调查过程可能会延长,甚至可能持续多年。

而此轮,NHTSA对特斯拉的调查是从2021年开始的,显然“很特殊”。2021年8月中旬,NHTSA即对外表示,已经对特斯拉的自动辅助驾驶系统启动正式调查。调查涉及大约76.5万辆特斯拉Model Y、Model X、Model S、Model 3车辆。NHTSA称,这一问题此前已引发11起事故或火灾,导致17人受伤和1人死亡。同年,8月底,随着美国佛罗里达州奥兰多市“第12起事故”的发生,NHTSA又给特斯拉发送了一封长达11页的信件,要求其给出所有车辆信息,并具体阐述自动驾驶模式下车辆如何应对紧急事故。

2021年8月一辆特斯拉Model 3在奥兰多撞上佛罗里达州公路巡逻车据 NHTSA 称,在这11 起事故中,特斯拉汽车均启用了自动驾驶仪或交通感知巡航控制系统。大多数事件发生在天黑后,涉及急救人员灯光、照明弹、发光箭头板或路锥。它希望弄清楚,Autopilot缺陷或设计问题是否与一系列撞车事故有关,甚至是直接原因。然而当时特斯拉并没有给出相应回应,反而于2021年9月通过无线软件更新方式向客户推送了“应急灯检测更新”。

紧接着,当年10月中旬,NHTSA在官网又发布“致特斯拉的一封信”,要求其就上述采取的行动提供更多信息。有意思的是,信件发布后不久,特斯拉没有回应置评请求,反而在Twitter上发文表示:“安全将通过无线更新继续提高。”与此同时,围绕11起事故展开的PE21020升级成了正式的EA22002号工程分析(engineering analysis)。双方的“拉锯战”一直持续到今年4月底,算是阶段性的结束。03新一轮“拉锯战”开始尽管马斯克认为NHTSA对Autopilot的调查是“愚蠢的”,但“身体很诚实”。

近年来,特斯拉在不断针对自动驾驶软件进行调整,其中很大程度也是参考了NHTSA提出的问题。比如,去年12月,特斯拉宣布将实施其历史上规模最大的一次召回行动,涉及203万辆在美国的汽车,几乎包括了所有在美国道路上行驶的特斯拉车辆,目的是为了更有效地确保驾驶员在使用高级自动辅助驾驶系统时能够保持注意力。召回计划覆盖了2012年至2024年期间在美国生产的配备自动驾驶系统的Model Y、X、S、3和Cybertruck车型。

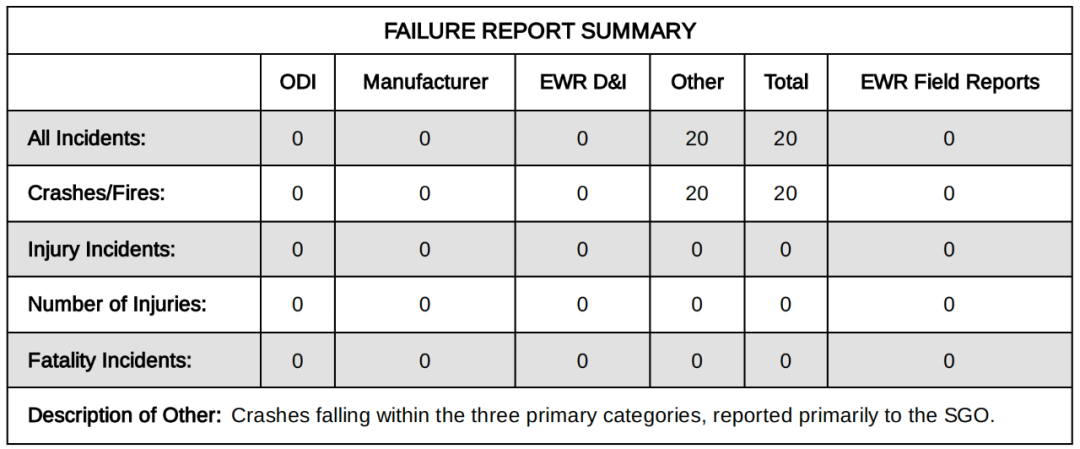

NHTSA对特斯拉展开新的调查对于上述召回计划,NHTSA认为补救措施效果不佳,甚至延续了EA22002号调查存在的“老毛病”。在NHTSA看来,媒体上仍有很多与Autopilot相关的事故报道,特斯拉的软件升级可能还不够完善。数据显示,在召回后的几个月里,特斯拉Autopilot至少发生了20起撞车事故。

特斯拉Autopilot近期至少发生20起撞车事故于是,今年4月底,NHTSA在官网发布信件,要对这次软件升级的有效性展开新的调查。NHTSA要求,特斯拉在7月1日的最后期限前向其提供有关该公司有史以来最大规模召回的信息。包括提供消费者使用其驾驶辅助系统的累计里程数据,以及在该公司去年12月召回汽车前后,司机被警告把手放在方向盘上的次数。

如果特斯拉未能及时、全面地回应NHTSA,该公司将面临每天每起违规行为高达27168美元的罚款,最高罚款超过1.35亿美元。显然,NHTSA与特斯拉之前的“战争”还会持续很久。可能特斯拉不愿意如此。但对于消费者,甚至特斯拉而言,在新技术落地上车,涉及人身安全的时刻,有NHTSA不断敲打,不失为一件幸事。

原文标题 : 美国监管部门调查三年后认定,特斯拉Autopilot就是有问题