自动驾驶3.0,开始拼算力

“大众辅助驾驶,拥堵跟车把变道的前车给撞了”

“有次在高速ACC帮我防止了追尾。”

用户对辅助驾驶的评价,呈现出两极分化。

事实上,从目前的许多事故上来看,辅助驾驶确实还很难说得上安全,就在不久之前,开着LCC功能的小鹏就在高速追尾;之后也有特斯拉在进入小区时突然加速。

而这一系列的事故也给了广大车主一个非常强的不信任感。辅助驾驶在高速、停车场这样相对简单的场景都不能保证安全,那在更复杂的城市道路上又值得信任吗?

顾维灏认为,目前城市辅助驾驶的挑战主要还是道路的复杂性,具体表现为城市道路养护,大型车辆密集,变道空间狭窄,城市环境多样四个方面。而要解决这些问题,AI就需要更多的数据样本进行训练,所以数据也就成了驱动自动驾驶成熟的核心。

区别于之前辅助驾驶将单个传感器数据在车载大算力芯片上进行计算,在进入城市辅助驾驶之后,毫末开始将所有传感器的原始数据放在一起,然后再通过AI大模型输出车辆的全局感知结果。

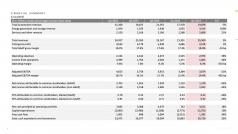

图:毫末将环绕车身的传感器数据整合在一起,输出当前路况信息

这样做的好处是,车辆在认知领域的进步可以逐渐脱离之前人为设定的规则,然后逐渐把人类真实驾驶的行为和常识提取出来。简单说就是让AI驾驶更像人类的老司机。但要达到这种状态,那支持训练的模型的数据至少要超过1亿公里。

除此之外,进入城市道路之后,汽车也要开始适应人类常用的交互方式,比如要理解周围车辆转向灯、尾灯的不同信号的意图。但现在市面上,不同车型、不同形状的尾灯都有很多,这不仅对算法识别带来挑战,庞大的数据量同样也会增加。

为了解决AI训练中语义理解的问题,谷歌在四月份发布了一个新的训练模型——Pathways Language Model(PaLM),由于其训练参数达到5400亿,使用了7800亿个Tokens,也被大家戏称为,让世界没有难懂的梗。但这种能力要使用到自动驾驶环境,也要求自动驾驶训练的里程至少在一亿公里以上。

图:PaLM用two-shot prompts解释了一个原创笑话

很显然,要训练出好的自动驾驶,未来的数据量会变得越来越大,特斯拉现在拥有三大数据中心,总计11544GPUs。为了提高数据的使用效率,特斯拉在2021年AI DAY上还发布了自研的DOJO超级计算系统和D1芯片。

但传统的数据使用方式还是制约了自动驾驶的发展。在之前,大量的数据进入训练阶段之前,都需要人工进行标注,即人要先告诉AI,这个东西是红绿灯,那个东西是栅栏,帮助AI建立基本认知。庞大的数据标注催生了数据标注师这个职业,也一度被人们戏称“有多少人工就有多少智能”。

但这种依赖人工标注的训练方式也存在许多问题,比如大量时间和成本的占用。顾维灏在毫末AI DAY上表示,之前的AI训练中,成本主要用在了训练标注上。而在今年6月份,特斯拉加州办公室有近200位员工被裁,主要也是自动驾驶的数据标注团队。

为了解决数据标注的成本问题,特斯拉也开始引入效率更高,成本更低的数据标注系统。这个系统只需要将车辆在路上行驶采集到的真实驾驶数据,再利用标注好的数据来训练模型,将结果进行联合优化以后便可以得到更加精确和详细的标注结果,整个过程都不需要人工的参与。

在2021年8月的AI Day上,特斯拉Autopilot的软件总监Ashok Elluswamy就表示,他们可以在一周内自动标记10k个clips(最小标注单元),而之前这个工作量至少需要几个月的时间。

图:数据标注示意

在国内,毫末采用的大模型训练方式也有异曲同工之处。

毫末的方案是用大量未经标注的数据进行预训练,然后形成一个主干模型,之后再用标注过的数据在特定的任务上做特定的优化。通过这种方式,毫末让训练效率提升了三倍,精度和准确性也远高于之前只用标注数据训练的结果。

清华大学智能科学讲席教授,中国工程院外籍院士张亚勤表示,自动驾驶正在逐步在向大模型,大数据、预训练、多模态、端到端的趋势发展。

最近几年,随着Attention to Transformer的广泛应用,AI的自然语言识别效果很快超过了人类的平均水平。但问题也随之而来,这种大模型对算力的消耗要远远高于摩尔定律能给到的支持。这也导致AI大模型的训练成本太高了,传导之后,也让自动驾驶在车端的落地变得比较复杂。

针对这个问题,目前行业里也在积极探索解决方案。目前主流的方案有两种,一种是轻量化,另一种是降低计算中的弱关联计算。

首先是轻量化。Attention to Transformer这种模型,其计算力和计算量比之前的CNN(卷积神经网络)要高100倍,而这100倍的冗余显然还没有达到完全释放的时候,所以许多玩家就在尝试将CNN与Attention在不同环节做不同程度的融合,以达到降低算力,实现轻量化的目的。其中像苹果在2021年提出的mobileVit和三星在今年提出的XFormer都是其中代表。

另一个则是降低弱关联计算。要知道,Attention其实有一个特点,就是在庞大的计算中,6.9%的计算贡献了大概94%的价值,剩下93%左右的计算则是弱关联计算,并没有太大的作用,这就造成了非常庞大的算力浪费。

基于这样的特点,清华的一位教授开始针对Attention的机制设计芯片(之前相关芯片的设计都是针对CNN进行的),以达到降低弱关联计算的目的。

图:芯片上设计独立的单元结构,计算上大值精确,小值近似;以及双向的渐进式方式来减少弱关联的计算,实现了在28nm的芯片上27.5TOS/W的能耗。

顾维灏认为,自动驾驶需要的数据主要是两个方面,一个是规模,另一个是多样性。我们今天做的所有工作,都是为了更加高效,低成本地获取数据。然后把数据送到计算中心,用训练的方法把数据转换为自动驾驶的能力。

除了在算法模型上下的功夫之外,算力也是未来自动驾驶能力的关键。

8月初,小鹏与阿里云专门为自动驾驶建立的智算中心“扶摇”,在被称为“草原云谷”的乌兰察布正式落成。这座智算中心算力可达600PFLOPS,用于小鹏的自动驾驶模型训练。

而在刚刚举办的AI DAY上,毫末也公布了首个超算中心。顾维灏表示,毫末超算中心的目标是满足千亿参数大模型,训练数据规模100万clips,将整体训练成本降低200倍。

随着自动驾驶发展阶段的改变,自动驾驶公司的成本重心也开始发生转移。“自动驾驶2.0阶段,钱都花在数据标注上了,应用大模型后的3.0时代,成本会发生转移,会从标注转到计算。”顾维灏称。

总之,数据的规模、获取成本、质量、处理速度等,都和自动驾驶能力的提升速度正相关。自动驾驶已经进入了依靠算力推动数据处理的时代。

结语

如今,各地政府也在加快推进自动驾驶和辅助驾驶的发展。

9月初,上海市政府印发《上海市加快智能网联汽车创新发展实施方案》,目标到2025年,具备组合驾驶辅助功能(L2级)和有条件自动驾驶功能(L3级)汽车占新车生产比例超过70%,具备高度自动驾驶功能(L4级及以上)汽车在限定区域和特定场景实现商业化应用。

在2022世界智能网联汽车大会上,北京经开区相关负责人表示自动驾驶示范区开启3.0阶段将实现全域信号覆盖。

截至目前,北京经开区已经建成329个智能网联标准路口,双向750公里城市道路和10公里高速公路实现车路云一体化功能覆盖,并汇聚了产业相关领域百余家企业、国内顶级院校与研究机构参与示范区建设。

除此之外,还有像深圳、广州、长沙、成都、上海等全国多个城市都在积极推动自动(辅助)驾驶落地。一系列的举措,也都将推动辅助驾驶和自动驾驶加快落地。

8月28日,百度集团资深副总裁、智能驾驶事业群组总经理李震宇表示:“自动驾驶正成为智能汽车竞争的焦点,未来3-5年,将是全球汽车智能化竞争的关键窗口期,2030年没有自动驾驶能力的电动汽车将完全失去竞争力。”

原文标题 : 自动驾驶打“巷战”